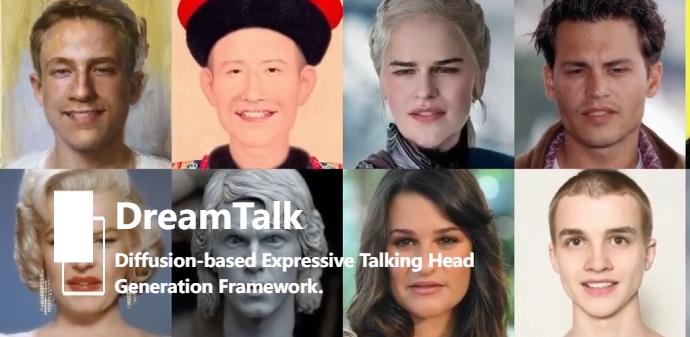

DreamTalk 简介

DreamTalk 是一个由清华大学、阿里巴巴和华中科技大学共同开发的先进框架,专门用于生成能根据音频说话和唱歌的人物头像动画。这个基于扩散模型的框架能够生成非常真实的人物脸部动作,同时展现丰富的表情,并且支持多种语言。DreamTalk 还能根据语音预测说话者的风格,并同步表达相应的表情,适用于多种场景,包括嘈杂环境。

主要特点

- 高质量动画:生成真实且流畅的人物脸部动作。

- 多样化表情:不仅嘴唇动作逼真,还能呈现出丰富的表情变化。

- 支持多种语言:可以同步中文、英文及其他语言的音频。

- 说话风格预测:根据语音预测说话者的风格,并同步表情。

- 适用多种场景:适用于不同类型的肖像和歌曲,即使在嘈杂环境中也能良好工作。

工作原理

- 去噪网络:使用扩散模型逐步去除噪声,生成清晰、高质量的面部表情。

- 风格感知的嘴唇专家:专注于提高嘴唇动作的表现力和准确性。

- 风格预测器:从音频直接预测目标表情,无需额外的表情参考。

- 音频和视频处理:提取音频特征以驱动面部动画,处理视频输入以模仿特定表情和风格。

- 数据和模型训练:利用大量数据训练模型,学习如何准确生成与输入音频匹配的面部动作。

应用场景

DreamTalk 的应用场景广泛,包括虚拟现实、在线教育、娱乐行业和数字媒体制作。它能够为虚拟角色提供逼真的面部表情和动作,提升虚拟互动体验。此外,也适用于创建音乐视频、电影和游戏中的动态角色,甚至可以用于生成仿真新闻播报员或虚拟助手。

下载地址

有关DreamTalk的更多信息和演示,可以访问其项目页面:DreamTalk 项目页面。