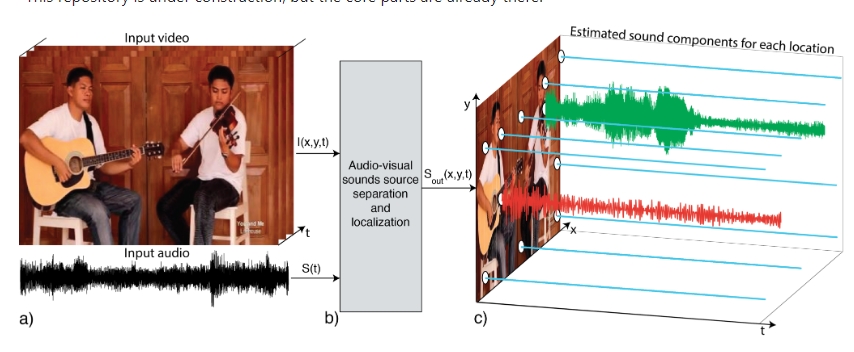

PixelPlayer 是由 MIT 研究团队开发的一个创新项目,它能自动从视频中识别和分离出不同的声音源,并将这些声音与视频中的画面位置匹配。这意味着,PixelPlayer可以识别视频中的特定人物正在说话或某个乐器正在被演奏,并能够独立提取和分离这些声音源。这种能力极大地拓宽了音视频编辑、多媒体内容制作、增强现实应用等领域的可能性,使得独立调整视频中不同声音源的音量、去除或增强特定声音源等操作变得可行。

软件功能

- 声音源分离:通过分析视频,将声音信号分离成多个组件,每个组件对应视频中的一个特定区域,实现不同声音来源的识别和分离。

- 声音定位:确定视频中产生特定声音的区域,如识别正在说话的人物或演奏乐器的位置。

- 多声音源处理:即使视频中有多个声音源同时发出声音,也能够分别识别和处理它们。

工作原理

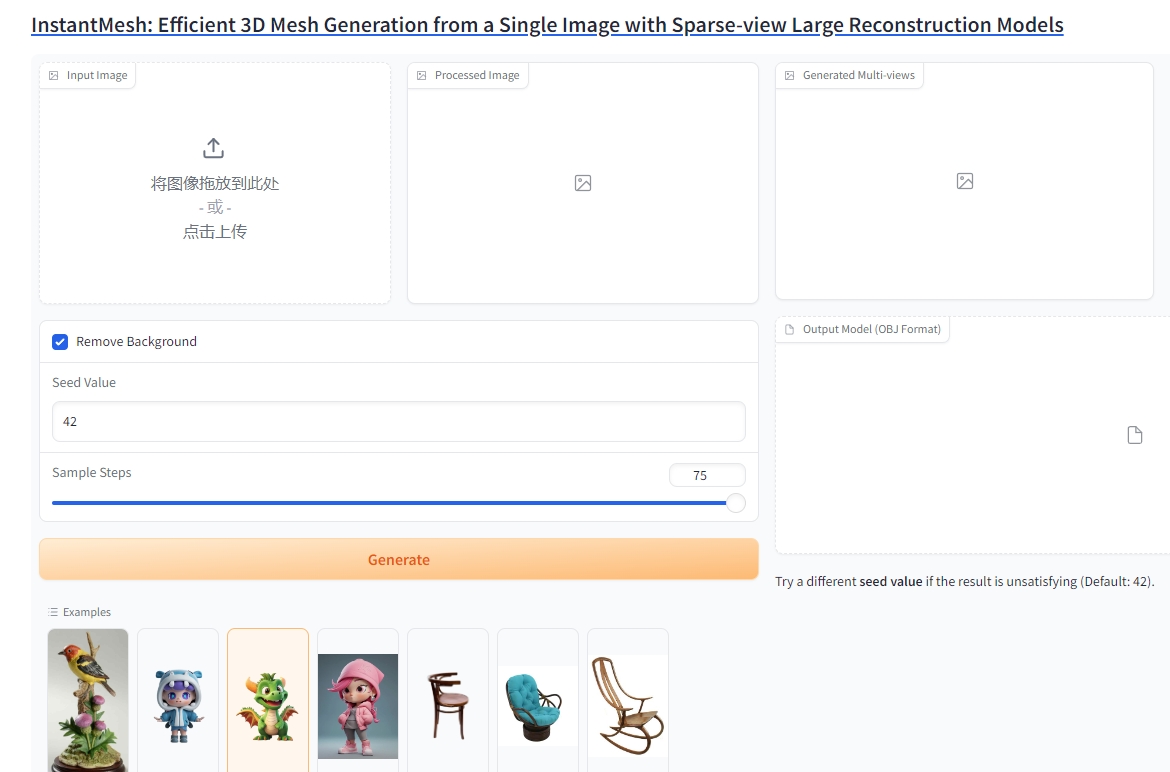

- 大规模视频训练:使用包含不同乐器组合演奏的大量视频进行系统训练,无需提供乐器、位置或声音的具体信息。

- 数据驱动学习:PixelPlayer通过观看大量未标记视频,自学习理解声音和图像之间的关系,实现声音源的分离和定位。

- 视音频同步利用:依赖于声音产生与视觉元素(如人物动作或乐器演奏)的自然同步关系,学习不同物体或行为产生的声音特征。

- 声音与像素的关联:为视频中的每个像素分配声音成分,实现声音的精确定位和分离。

- 声音分离技术:采用先进的声音处理技术,如源分离算法,将混合音频信号分离成多个独立声音通道。

应用场景

- 音视频源分离:自动从视频中分离出各种声音源,为音乐制作和编辑提供便利。

- 声音定位:为增强现实(AR)和虚拟现实(VR)应用提供新的可能性,根据用户视角和互动逼真地模拟声音来源。

- AI内容配音:帮助内容创作者为视觉内容配音,例如自动为动画角色或物体添加特定声音效果。

- 自动字幕和描述生成:通过识别和分离视频中的声音来源,提高视频内容的可访问性。

- 音频可视化:通过将声音与视觉内容直接关联,创造新颖的音乐可视化体验。

- 音乐教学和学习:展示不同乐器在合奏中的声音分布和特点,帮助学生理解乐曲结构。

PixelPlayer不仅推动了音视频处理技术的边界,也为多模态人工智能研究和应用开辟了新的道路。