M2UGen是由腾讯和新加坡国立大学共同开发的一款多模态音乐理解和生成模型。这个模型不仅能够理解不同类型的音乐,还能基于多种输入如文本、图像、视频和音频生成音乐。M2UGen的独特之处在于其能够理解音乐的风格、演奏的乐器以及表达的情绪情感,并对此进行音乐问答。

软件功能

- 音乐问答:M2UGen 能理解包括风格、乐器使用、情绪和情感在内的各种音乐类型,并回答相关问题。

- 文本到音乐生成:用户输入文本,模型根据这些文本生成相应的音乐。

- 图像到音乐生成:能够根据提供的图片内容生成匹配的音乐。

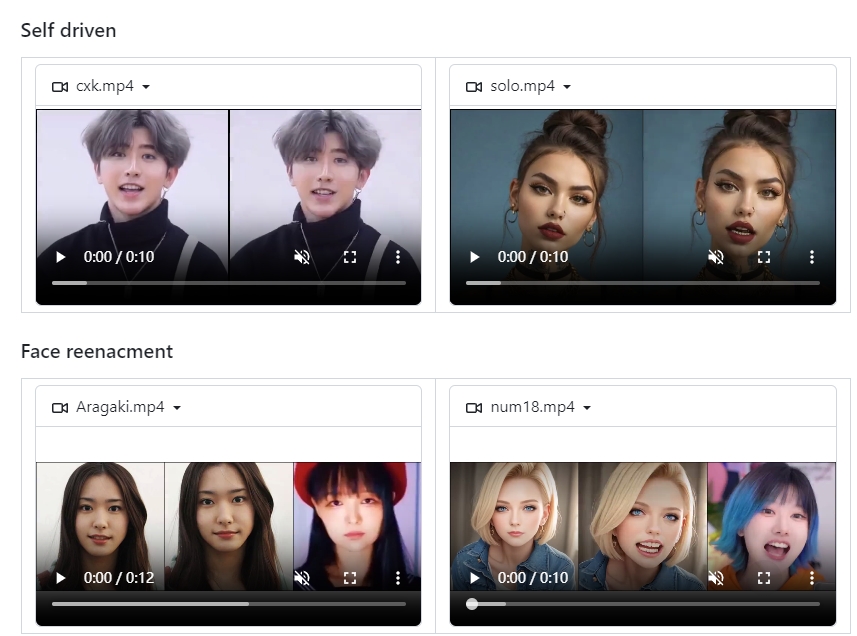

- 视频到音乐生成:根据视频内容,理解视频主题并生成相应音乐。

- 音乐编辑:用户可通过文本描述来编辑已生成的音乐,如改变乐器、调整节奏等。

软件特点

- 多模态输入处理:M2UGen 能处理文本、图像、视频和音频等多种输入,使用特定编码器理解不同模态。

- 音乐理解与生成:利用 Llama 2 模型,深入理解音乐并生成新音乐。

- 多种编码器的使用:包括 MERT(音乐理解)、ViT(图像理解)、ViViT(视频理解)以及 MusicGen/AudioLDM2(音乐生成模型)。

下载地址

暂无公开的官方下载地址,但可以通过其项目页面了解更多信息和演示。